NVIDIA GTC 2026: o começo definitivo da era da execução em IA

Time editorial Stalse - 25 de março de 2026

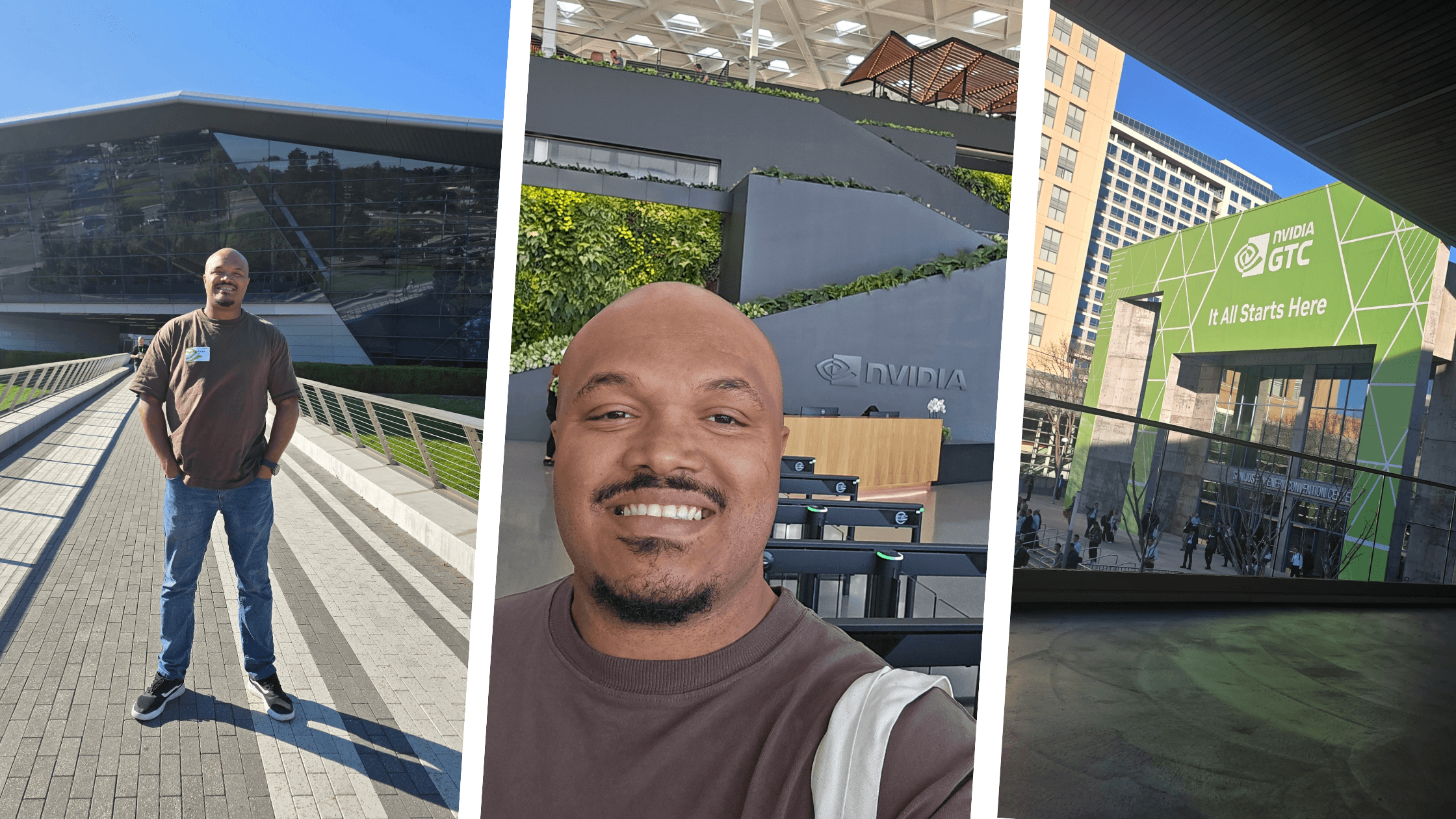

O palco era o SAP Center, em San José, Califórnia. A plateia, mais de 25 mil pessoas presencialmente e milhões em streaming ao redor do mundo. E o roteiro, entregue com a precisão teatral de quem já fez deste evento um marco anual do calendário corporativo global, foi o de Jensen Huang, CEO da NVIDIA, no keynote da NVIDIA GTC 2026. O que vimos por lá foi uma declaração de época: a era do treinamento de IA chegou ao seu limite de retorno sobre investimento, e o futuro pertence a quem dominar a inferência.

Para os decisores que acompanham a NVIDIA apenas como fabricante de chips gráficos, é hora de atualizar o modelo mental. A empresa se consolidou como a camada operacional da inteligência artificial global, e as decisões tomadas em San José em março de 2026 vão impactar diretamente os orçamentos de tecnologia, as estratégias de dados e a competitividade das empresas nos próximos três a cinco anos.

A Stalse marcou presença na conferência, observando de perto as discussões que impactarão diretamente a forma de escalar negócios por meio de dados e IA. Neste artigo, você confere os principais temas e insights do NVIDIA GTC 2026 que destacamos para os tomadores de decisão.

A mudança estratégica: do treinamento para a inferência

O custo do treinamento chegou ao seu teto

Durante anos, a corrida das grandes empresas de tecnologia foi centrada em uma métrica: quão grande pode ser o modelo? Treinar um LLM de próxima geração significava alugar (ou comprar) milhares de GPUs por meses, gastando centenas de milhões de dólares. Essa fase produziu avanços extraordinários, mas também criou uma ilusão perigosa: a de que escalar treinamento seria suficiente para escalar valor de negócio.

Jensen Huang foi direto ao ponto no GTC 2026: o ROI do pré-treinamento está em queda livre. O ganho marginal de performance por dólar investido em treinar modelos maiores diminuiu significativamente. O que não diminui — e cresce exponencialmente — é o custo de rodar esses modelos no dia a dia. Cada consulta a um agente de IA, resposta gerada e análise executada em tempo real tem um custo de inferência. E é nesse custo que as empresas estão sangrando sem perceber, como pode ser observado em uma valiosa análise presente neste pivot estratégico da NVIDIA publicado pela CNBC.

O que muda para os decisores?

A pergunta que os CFOs deveriam estar fazendo não é mais 'quanto custou treinar nosso modelo?', mas sim 'quanto estamos gastando para que ele responda uma pergunta?'.

Esse deslocamento de foco — do CAPEX de treinamento para o OPEX de inferência — muda completamente a lógica de investimento em IA. Empresas que construíram suas estratégias apenas em cima de modelos proprietários ou acordos de treinamento exclusivo agora precisam revisitar suas arquiteturas. Como aponta a análise da Bain & Company, a IA se consolidou como o sistema operacional das organizações modernas. E, como todo sistema operacional, sua verdadeira conta vem no uso contínuo, não na instalação.

AI Factories e eficiência de infraestrutura: a arquitetura Vera Rubin

Data centers como fábricas de tokens

Um dos conceitos mais poderosos introduzidos no GTC 2026 é o de AI Factory — a reconfiguração do data center não como repositório de dados, mas como linha de produção industrial de tokens. Assim como uma fábrica de manufatura é avaliada pela eficiência por unidade produzida, os novos data centers devem ser avaliados pelo custo por token gerado. É uma mudança de paradigma que impacta diretamente como as áreas de infraestrutura, finanças e estratégia conversam entre si.

Vera Rubin: a arquitetura que redefine o custo da escala

A nova arquitetura Vera Rubin, apresentada no GTC como a sucessora da linha Blackwell, entrega números que devem constar em qualquer apresentação de ROI tecnológico para o board. Segundo análise do Tom's Hardware, a Vera Rubin promete:

- 10x de redução no custo por token em comparação com a geração Blackwell, o que significa que a mesma carga de trabalho analítica pode custar dez vezes menos em infraestrutura.

- De 2 dias para 2 horas no tempo de instalação de novos nós de processamento, graças ao sistema de resfriamento líquido direto integrado ao design do hardware.

- Arquitetura NVL72 com conectividade de altíssima largura de banda entre GPUs, eliminando os gargalos de memória que tornam pipelines de Analytics lentos e caros.

Esse salto de eficiência é uma virada de jogo para qualquer empresa que opera Analytics em escala: modelos que hoje consomem orçamento expressivo em inferência podem ser rodados por uma fração do custo em infraestrutura Vera Rubin, como detalhou Huang neste vídeo.

O impacto para tomadores de decisão

A projeção de demanda por chips de IA ultrapassa US$ 1 trilhão até 2027. Esse número, por si só, sinaliza que não se trata de uma tendência especulativa, mas sim de um mercado em consolidação acelerada. Empresas que adiarem a transição para arquiteturas otimizadas serão penalizadas com custos crescentes a cada query executada. Em contrapartida, os concorrentes que fizerem essa migração agora operarão com uma vantagem estrutural de custo e eficiência que será muito difícil de ser revertida por quem ficar para trás.

A resolução do gargalo de processamento: o fator Groq

Quando a CPU virou o elo fraco

Por décadas, os processadores centrais (CPUs) foram o coração das infraestruturas computacionais. Com a ascensão da IA, as GPUs assumiram o protagonismo no treinamento. Mas existe um terceiro ator nessa equação que poucos discutem abertamente: a CPU que alimenta a GPU está se tornando o maior gargalo da inferência de IA.

Em workloads de IA generativa e Analytics em tempo real, a GPU frequentemente fica ociosa esperando que a CPU organize, prepare e envie os dados. Isso significa que parte significativa da capacidade de processamento adquirida (e paga) simplesmente não está sendo usada. O resultado é um custo por resposta inflado e uma latência que inviabiliza casos de uso que exigem tempo real.

A aquisição da Groq por US$ 20 bilhões: muito além de um M&A

O anúncio mais estratégico do GTC 2026, do ponto de vista de arquitetura de negócios, foi a integração oficial da tecnologia da Groq ao ecossistema NVIDIA. Fruto de uma aquisição de ativos de US$ 20 bilhões realizada em dezembro, a NVIDIA revelou como vai utilizar as LPUs (Language Processing Units) da Groq — chips projetados especificamente para inferência de linguagem natural em velocidade extrema. Conforme reportado, essa arquitetura combinada promete:

- Até 35 vezes mais rapidez na aceleração de inferência, desbloqueando respostas em milissegundos onde antes levavam segundos.

- Eliminação das filas de processamento que mantinham servidores ociosos enquanto aguardavam a CPU liberar dados.

- Habilitação de casos de uso que exigem latência ultrabaixa, permitindo atendimento ao cliente com IA em tempo real, detecção de fraudes e monitoramento preditivo contínuo.

A mensagem para os decisores é objetiva: a combinação GPU + LPU desbloqueia uma nova categoria de aplicações de IA que eram inviáveis economicamente até hoje. Qualquer empresa que opera com filas de processamento longas, alta latência em consultas analíticas ou custos excessivos em APIs de IA deve avaliar como essa arquitetura impacta sua operação.

Nemo Claw: a governança dos agentes autônomos

O problema que ninguém quer admitir no board

Agentes de IA autônomos são a promessa mais sedutora da tecnologia atual: sistemas capazes de executar tarefas complexas, tomar decisões intermediárias e interagir com outros sistemas sem intervenção humana constante. Mas existe um risco operacional sério que acompanha essa promessa: agentes sem supervisão são agentes sem orçamento definido.

Um agente que decide, por conta própria, fazer 10 mil chamadas a uma API externa ou processar um volume de dados inesperado pode gerar uma fatura de infraestrutura que nenhum comitê ou decisor aprovou. Em escala corporativa, com dezenas ou centenas de agentes rodando em paralelo, esse risco se multiplica de forma não linear.

Nemo Claw como camada de controle corporativo

O NVIDIA Nemo Claw foi posicionado no GTC 2026 como a resposta a esse problema: uma camada de guardrails para agentes de IA que permite às organizações definir limites operacionais, políticas de uso e thresholds orçamentários que os agentes não podem ultrapassar sem aprovação humana. Na prática, é o equivalente corporativo de colocar um limite de gastos em um cartão corporativo.

Os principais controles que o Nemo Claw oferece incluem:

- Políticas de conformidade: agentes só podem acessar dados e sistemas para os quais têm autorização explícita.

- Limites orçamentários em tempo real: o sistema interrompe automaticamente fluxos que ultrapassem thresholds de custo pré-definidos.

- Auditoria de decisões: rastreabilidade completa de cada ação executada pelo agente, essencial para compliance em setores regulados.

- Integração com governança de dados: o agente opera dentro das políticas de segurança e privacidade já estabelecidas pela organização.

Para CFOs e CROs, o Nemo Claw resolve um dos principais bloqueios à adoção de IA autônoma em escala: a impossibilidade de prever e controlar os custos operacionais de agentes não supervisionados. Com guardrails, a IA autônoma deixa de ser um risco financeiro aberto e passa a ser uma alavanca de produtividade com envelope de custo definido.

O impacto real: Physical AI, Robótica e o futuro tangível

Quando Analytics flui sem gargalos, a IA toca o mundo físico

Os quatro tópicos que destacamos anteriormente convergem para uma conclusão que poucos conseguem visualizar claramente: quando o custo de inferência cai, a latência desaparece e a governança está em ordem, o próximo passo da IA é interagir com o mundo físico em tempo real.

Esse é o conceito de Inteligência Artificial Física (Physical AI) que a NVIDIA apresentou no GTC 2026. São aplicações já em desenvolvimento e implantação que dependem exatamente da infraestrutura discutida até aqui.

Exemplos concretos que saíram do palco da GTC

Olaf, o robô da Disney

A Disney apresentou no GTC um robô de interação com visitantes baseado no personagem Olaf, da animação Frozen. O sistema processa linguagem natural, reconhece contexto emocional e responde de forma coerente com a personalidade do personagem, em tempo real e sem latência perceptível. Isso só é possível com inferência de alta velocidade e baixo custo. Em escala de parque temático, com centenas de robôs interativos simultâneos, a eficiência de infraestrutura não é detalhe: é a viabilidade financeira do projeto inteiro.

IA física e veículos autônomos com raciocínio próprio

A IA física aplicada a veículos autônomos também foi pauta relevante nesse âmbito. Os carros estão deixando de ter apenas "reflexos" programados para ganharem capacidade real de raciocínio (reasoning). Os sistemas agora conseguem narrar e justificar suas decisões de direção em tempo real — como desviar de um carro estacionado irregularmente.

Um dos pontos destacados foram as simulações fotorrealistas no Omniverse para o treinamento seguro desses modelos. Aliados a elas, os carros autônomos se tornam não apenas mais seguros, mas economicamente escaláveis para produção em massa, com parcerias já anunciadas com montadoras como BYD e operadoras como a Uber.

O que isso significa para empresas fora do setor de tecnologia?

A lição estratégica do Physical AI é a de que toda empresa que opera processos físicos — como logística, manufatura, varejo, saúde e energia, por exemplo — poderá ter acesso a uma infraestrutura de IA cujo custo vem caindo dramaticamente e cuja capacidade de resposta em tempo real está se tornando mais viável. O monitoramento inteligente de uma linha de produção, a otimização logística em tempo real, o atendimento presencial aumentado por IA; tudo isso deixa de ser projeto piloto caro e começa a ser iniciativa com ROI calculável.

O mapa estratégico: o que os C-Levels precisam decidir agora

O que ficou claro após esta imersão no evento é que as discussões e anúncios realizados no NVIDIA GTC 2026 ofereceram um verdadeiro mapa de redistribuição de vantagem competitiva. As empresas que saíram de San José com uma agenda de ação estruturada já começaram a criar distância dos que ainda estão processando o que viram.

Os pontos de decisão imediatos para o board incluem:

- Auditoria de custos de inferência: Quanto sua empresa gasta hoje por query, por sessão de agente, por análise executada? Esse número é visível para o CFO? Se não, essa é a primeira lacuna a fechar.

- Roadmap de modernização de infraestrutura: Quando sua arquitetura de dados foi desenhada? Se for anterior a 2023, ela provavelmente não foi projetada para workloads de inferência contínua. A janela para migração antes que os custos se tornem anticompetitivos está se fechando.

- Política de governança para agentes autônomos: Sua empresa já tem agentes de IA em produção? Quem define os limites operacionais e orçamentários desses agentes? Sem essa política, cada novo agente implantado é um risco financeiro aberto.

- Identificação de casos de uso de Physical AI: Quais processos físicos da sua operação poderiam se beneficiar de monitoramento inteligente em tempo real? Com o custo de inferência em queda e arquiteturas como a Vera Rubin disponíveis em 2H 2026, o cálculo de viabilidade muda completamente.

A alta demanda prevista pela NVIDIA reflete um mercado que está, simultaneamente, migrando sua infraestrutura existente e construindo novas camadas de aplicação que antes eram inviáveis. Quem estiver bem posicionado nessa migração colherá vantagem estrutural.

Conclusão: escalar dados e processos de IA não é mais uma opção

O GTC 2026 entregou uma mensagem unificada para quem esteve presente em San José e para quem acompanha a NVIDIA com atenção estratégica: o ritmo de transformação da infraestrutura de IA já não permite que as organizações operem com a cadência de decisão dos ciclos anteriores.

Para os líderes que precisam traduzir tudo isso em decisão, a lição mais clara de San José é que a vantagem competitiva dos próximos anos não vai para quem adotar mais tecnologia de IA, mas para quem adotar com mais inteligência: com governança robusta, arquitetura otimizada para inferência, custos monitorados por token e parceiros tecnológicos capazes de navegar em ambientes de alta complexidade e velocidade de mudança.

Pronto para transformar esses insights em resultados reais de negócio?

A Stalse acompanhou de perto cada anúncio do GTC 2026 para oferecer um roadmap de implementação a empresas que querem aproveitar a nova arquitetura de inteligência artificial para escalar seus resultados e tornar o ROI sobre dados e IA palatável.

Se você é C-level ou decisor e quer entender, na prática, como implementar um monitoramento inteligente na sua infraestrutura de dados e IA, eliminando desperdícios, reduzindo o custo por token e garantindo governança sobre seus agentes autônomos, é hora de conversar com quem traduz inovação tecnológica em resultado de negócio. Entre em contato conosco clicando aqui.

Veja também: SXSW 2026 - as principais tendências que vão redefinir a estratégia dos negócios